📄 系统简介

内部资料,请扫码登录

PIG AI 是一款开源的大语言模型(LLM)应用开发平台,它结合了后端即服务(Backend as Service)和 LLMOps 的理念,使开发者能够快速搭建生产级的生成式 AI 应用。即使你是非技术人员,也能参与到 AI 应用的定义和数据运营过程中。

PIG AI 内置了构建 LLM 应用所需的关键技术栈,包括对数十个模型的支持、高质量的 RAG 引擎以及灵活的 Agent 框架,并提供了一套易用的界面和 API。这使得开发者可以节省大量重复造轮子的时间,适用于多种企业级商业场景,如企业智能客服、企业智能文档、专家顾问助理、业务联动等。

通过PIG AI,企业可以轻松构建出功能强大、高效智能的应用程序,提升业务流程的自动化程度和智能化水平,从而提高企业的竞争力和创新能力。

# 多模型支持

PIG AI 为以下模型提供商提供原生支持:

| 厂商 | 模型类型 | 模型名称 |

|---|---|---|

| 阿里百炼 | 聊天 | qwen-max-latest |

| 阿里百炼 | 聊天 | qwen-plus |

| 阿里百炼 | 视觉 | qwen-vl-max |

| 阿里百炼 | 向量 | text-embedding-v3 |

| 阿里百炼 | 图片 | flux-schnell |

| 阿里百炼 | 音频 | paraformer-v2 |

| 阿里百炼 | 音频 | cosyvoice-v1 |

| DeepSeek | 聊天 | deepseek-chat |

| DeepSeek | 聊天 | deepseek-reason |

| 零一万物 | 聊天 | yi-lightning |

| 讯飞星火 | 聊天 | Spark 4.0 Ultra/Max |

| 字节豆包 | 聊天 | Doubao-lite/Doubao-pro |

| 字节豆包 | 向量 | Doubao-embedding |

| 月之暗面 | 聊天 | kimi |

| 智谱清言 | 聊天 | glm-4-plus |

| 智谱清言 | 视觉 | glm-4v-plus |

| 智谱清言 | 向量 | embedding-3 |

| 硅基流动 | 图片 | black-forest-labs/FLUX.1-schnell |

| 硅基流动 | 音频 | FunAudioLLM/SenseVoiceSmall |

| OpenAI | 聊天 | gpt-4o-mini/4o |

| OpenAI | 视觉 | gpt-4o |

| OpenAI | 向量 | text-embedding-3-small |

| OpenAI | 向量 | text-embedding-3-large |

| Ollama | 聊天 | qwen2.5:14b/32b/72b |

| Ollama | 推理 | deepseek R1 |

| Ollama | 向量 | bge-m3 |

| Ollama | 视觉 | minicpm-v:latest |

理论上,我们的系统支持 Ollama (opens new window) 本地推理框架客户端,这使得一键部署像 Llama 2、Mistral、Llava 等大型语言模型成为可能。PIG AI 可以轻松接入 Ollama 部署的大型语言模型,并利用其强大的推理和 embedding 能力。这意味着我们的系统可以利用 Ollama 提供的高效、可扩展的推理框架,从而为用户提供更快速、更准确的语言理解和处理功能。通过与 Ollama 的集成,我们能够为用户带来更优秀的语言模型服务,助力他们在各种应用场景下实现更高水平的智能化处理。

# 深度推理 🔥

PIG AI 完整支持 DeepSeek 深度推理能力,通过 deepseek-reasoner 模型实现了更强大的推理和决策能力

# ① 全链路思维链保留

通过 deepseek-reasoner 模型完整保留 AI 的思维链推理过程,在输出最终答案前强制生成详细的分析推导步骤。这种机制使决策过程完全透明可追溯,通过逐步验证确保结论可靠性,彻底解决传统框架(如 Spring AI/LangChain)因丢弃中间推理环节导致的"AI 黑箱"问题。

# ② 实时联网搜索增强

突破大模型预训练数据的时间边界,通过智能联网搜索获取最新实时信息。系统自动抓取权威信源的高质量内容,结合思维链机制进行多维度分析验证,完美解决时效性敏感问题(如金融数据、科技动态、政策法规等),使 AI 始终基于最新认知进行决策。

这两大特性形成独特优势:全链路思维链确保推理过程可解释可审计,实时联网搜索突破模型知识时效限制。相比同质化严重的大模型产品,PIG AI 通过"深度推理+实时感知"的技术组合,为企业构建差异化的智能决策系统。

# RAG 知识库

RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索与文本生成相结合的技术范式。其核心思想是通过实时检索外部知识库获取与当前任务最相关的信息片段,将这些检索结果作为上下文输入给生成模型,从而提升生成内容的准确性和事实性。

主要技术优势包括:

- 基于 Java 技术栈深度优化,提供标准 API 接口,方便二开对接企业现有数据源系统

- 混合检索机制(向量+关键词+语义),通过多路召回策略显著提升查全率与查准率

- 多模态支持,通过 OCR+视觉大模型实现 PDF 扫描件、图片等非结构化资源精准解析

- 支持动态调整检索权重,可根据 query 类型自动切换稀疏/稠密向量混合检索模式

- 支持多种向量数据库(Qdrant/Chroma/Milvus/PGVector),提供统一接入规范实现无缝迁移

# ① 场景演示

PIG AI 的知识库功能确实非常强大,支持上传外部数据,如本地文件和实时数据,并利用向量搜索来检索最相关的内容以回答用户的问题。这种功能可以大大提高机器人的回答准确度和效率,使其能够更精确地理解和回应用户的提问。

通过上传外部数据,用户可以将各种类型的信息整合到 PIG AI 的知识库中,包括文档、数据库查询结果、实时数据等。然后,PIG AI 使用先进的向量搜索技术来对这些数据进行索引和搜索,以便快速找到与用户查询最相关的内容。

这种功能对于各种场景都非常有用,包括客户服务、技术支持、知识管理等。通过使用 PIG AI 的知识库功能,用户可以轻松构建出功能强大的智能问答系统,为用户提供更快速、更准确的帮助和支持。

- 向量检索

- 标记增强

# ② 知识库

将数据上传到 PIG AI 知识库后,PIG AI 会自动将你的文档分割成内容片段进行存储,并通过向量搜索来检索最相关的内容来回答用户问题。

例如:

你可以将几十页的产品介绍文档导入知识库,当 Bot 使用了这个知识库后,你就可以拥有一个专属产品顾问 Bot。

你可以将常关注的资讯网站或在线论文导入知识库,通过知识库的自动更新能力,让 Bot 帮助你收集最新数据。

PIG AI 知识库可以处理和理解来自不同模态(例如文本、图像、PDF、Office 等)的文档信息,使大型模型能够跨越多种输入形式进行学习和推理。

- 深度文档理解:能够从各类复杂格式的非结构化数据中提取真知灼见。

- 基于模板的文本切片:提供多种文本模板,实现智能且可控的文本处理。

- 降低幻觉(hallucination):通过文本切片过程可视化,支持手动调整,确保答案提供关键引用的快照并支持追根溯源。

- 兼容各类异构数据源:支持丰富的文件类型,包括 Word 文档、PPT、Excel 表格、txt 文件、图片、PDF、影印件、复印件、结构化数据和网页等。

为解决目前 RAG(Retrieval-Augmented Generation)在实施中遇到的问题,如数据库的多路召回能力和数据处理问题。通过提供专用的数据库和工具,旨在使 RAG 更易于被更多企业和个人使用,并解锁更多应用场景。

# Function 函数

# ① 场景演示

将自然语言转换为 API 调用参数或查询数据库的条件;提取文本中的结构化数据。提供基于通用大型模型的实时回调业务函数能力,Function Calling 使得 Chat Completion 模型可以调用外部函数获取信息再针对输出进行格式化。能够方便地扩展任何业务逻辑,使模型更了解业务,更敏捷地构建您的私域大模型。使用函数调用能力,可以满足当前大模型无法解决的部分问题,包括:

在进行自然语言交互时,可以通过调用外部工具回答问题(类似于 ChatGPT 插件)

将自然语言转换为调用 API 时使用的参数,或者查询数据库时使用的条件

从文本中提取结构化数据,实现 AI 表单

# ② 业务联动

将大模型回调业务系统的功能融入现有业务流程中 是一项关键任务。在这个过程中,首先需要经过现有业务的权限判断、参数校验等业务逻辑判断,以确保调用的合法性和准确性。一旦通过了这些判断,大模型回调功能就会被触发,开始执行相应的智能逻辑。

这种打通大模型和业务系统的壁垒,实际上是在传统应用中引入了更智能的处理方式。通过大模型的回调,业务系统可以获得更精准、更智能的决策支持,从而提升业务处理的效率和准确性。这种智能化的应用场景不仅可以优化现有业务流程,还可以为企业带来更多的竞争优势和创新可能性。

# ③ 扩展能力

PIG AI 提供了强大的功能调用支持,允许用户自行开发和实现 function calling,从而实现业务联动能力。这意味着用户可以根据自身业务需求,开发定制的功能模块,并通过 PIG AI 提供的方便 API 接口将这些功能集成到应用中。

- 用户可以根据自身需求开发具体的业务逻辑和处理流程,并将其封装为可被 PIG AI 调用的函数或服务。这样可以实现更高度定制化和个性化的应用功能。

- API 接口集成: PIG AI 提供了简单易用的 API 接口,用户可以通过实现 Function Calling,将自定义功能模块集成到 PIG AI 的应用中。这样,用户可以利用 PIG AI 强大的语言理解和处理能力,结合自身的业务逻辑,构建出完整的智能应用。

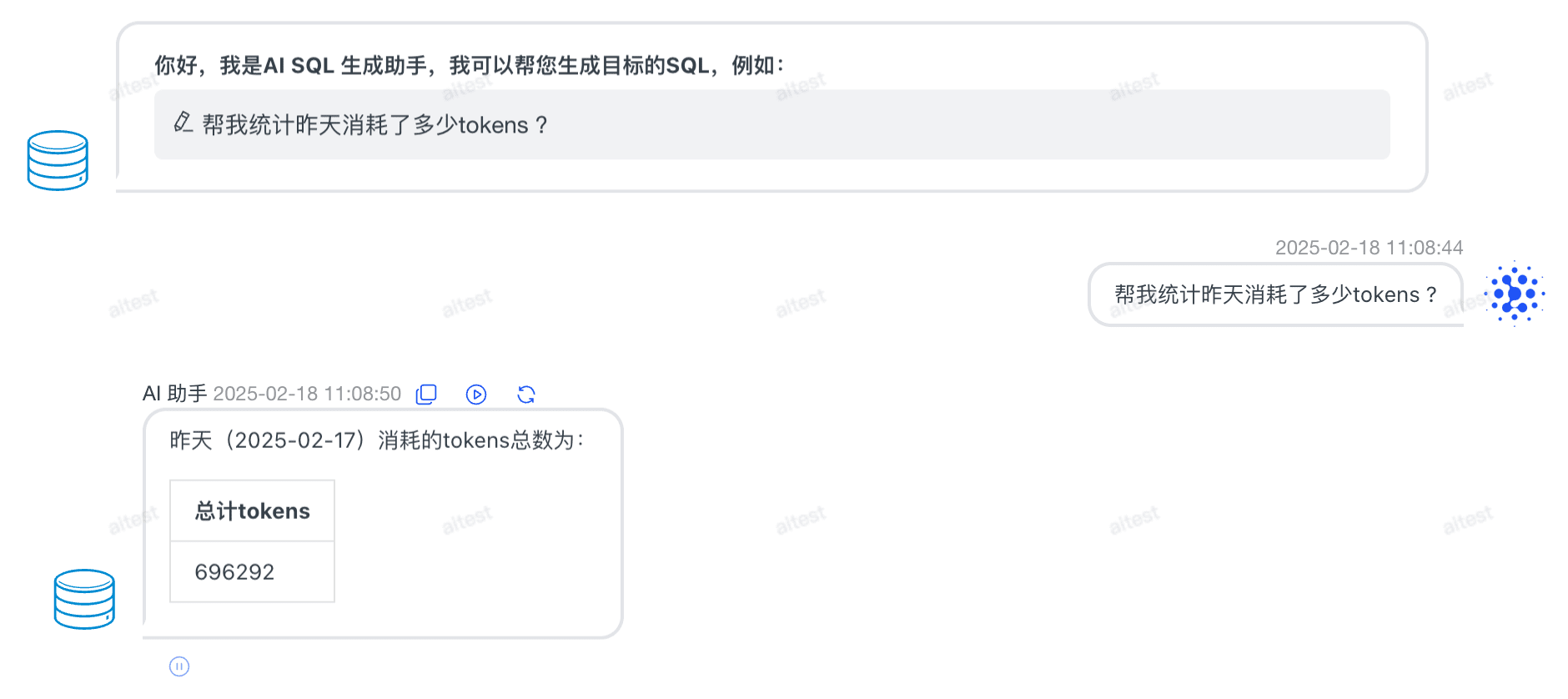

# Chat2SQL

Chat2SQL 能够实现**自然语言与 SQL 的转换,从而极大地提升了工作效率。在 AI 时代,数据库研发人员可以将 Chat2SQL 视为必备的利器,它为他们提供了便捷而高效的工作方式。即使是不懂 SQL 的运营或业务人员,也可以轻松地使用 Chat2SQL 进行快速的数据查询和报表生成。

Chat2SQL 还具有智能化的功能,能够根据上下文自动选中相关的数据表,并生成与业务需求相匹配的 SQL 查询语句。这种智能关联功能使得用户无需深入了解数据库结构,就能够轻松地执行复杂的数据查询操作,极大地降低了使用门槛,提高了工作效率。

# 函数编排

全新的函数编排功能,从模型描述、入参定义、调用增强到结果处理,均可在线设计和编辑,实现大模型驱动的复杂业务流程自动化。

# 多模态

PIG AI 提供全面的多模态支持,通过先进的大模型技术实现高质量的内容生成与转换能力。系统支持文本、图像、语音等多种模态的智能转换与协同处理,显著提升内容创作效率。

- 文生图: 根据文本描述智能生成高分辨率图像,支持艺术风格指定、细节参数调整和批量生成功能,可快速产出符合商业需求的视觉素材

- 文生脑图: 将结构化文本自动转换为可视化思维导图,支持多级节点展开、智能布局优化和多种主题模板选择,助力高效思维整理

- 文转语音: 提供拟人化语音合成服务,支持多语种发音人选择、情感语调调节和 SSML 标记控制,可生成广播级质量的语音内容

- 语音转文: 实现高精度语音识别转写,具备方言适应、背景音降噪和实时转写能力,支持标点自动生成与专业术语优化

通过统一的 API 接口,开发者可以便捷集成这些多模态能力到现有业务系统中,构建智能化的内容生产流水线。系统采用模块化设计,支持根据业务需求灵活组合不同模态的处理能力。

# AI OCR

PIG AI 提供了强大的 OCR(光学字符识别)能力,依托先进的大语言模型技术,支持多种复杂的识别场景,帮助企业和开发者高效处理图像中的文字和表格信息。其核心功能包括:

- 结构化 JSON 输出

- 所有识别结果均以结构化的 JSON 格式输出。无论是简单的文字识别,还是复杂的表格、段落、标题等,系统都会自动解析并按照逻辑结构化输出。

- 灵活的内容提取

- 支持从复杂场景中提取特定信息,如发票号码、日期、金额等特定关键字段,并根据业务需求自动调整输出格式。

- 可以通过配置自定义的字段规则,使得输出结果与业务系统无缝对接。

- 多语言支持与扩展性

- PIG AI OCR 支持多语言文字识别,能够针对国际化业务场景提供多语种识别服务。

- 系统还可以根据不同场景进行扩展,增加自定义字段解析与输出。

- 业务集成与调用

- OCR 结果通过 JSON 格式直接输出,业务系统可以便捷地解析并调用。

- 可以通过 API 接口调用 OCR 服务,实现自动化处理,提升业务流程的效率。

# 规则引擎增强

生成式 AI 因其特性而在各地区受到不同程度的管控,针对这一挑战,我们基于规则引擎平台实现了业务决策与代码解耦的创新方案。PIG AI 的规则引擎通过预定义语义模块承载业务规则,支持动态配置敏感词过滤、IP 地域限制、tokens 流量管控等多维度风控策略,实现毫秒级风险决策响应。系统优势体现在:

- 强风控能力:不仅满足各地合规要求,更通过可视化策略编排实现审查规则动态调整,支持敏感模式秒级生效

- 灵活解耦架构:将原本硬编码在业务逻辑中的风控规则抽象为独立可配置的规则节点,业务迭代无需修改核心代码

- 二开友好设计:提供标准化的规则扩展接口,新模型接入时可快速组合现有规则组件,业务扩展效率提升 70%以上

通过规则热更新机制,运维人员可在不停服的情况下实时调整审查策略,确保 AI 服务始终符合最新监管要求的同时,保持业务连续性。

# Java 技术栈

基于 Java 语言 进行系统开发,提供了丰富的模型支持,包括公有模型和私有模型,并且具有方便的扩展性和二次开发性。让我详细解释一下:

- 丰富的模型支持: PIG AI 提供了多种大模型支持,涵盖了文本、图片视觉、语音识别等模型。这些模型既包括了公有模型,也支持用户上传和使用私有模型,因此可以满足各种不同场景和需求下的系统开发。

- 方便的扩展性: PIG AI 提供了友好的接口和工具,方便开发人员轻松地扩展系统功能。无论是集成新的预训练模型,还是开发定制的模型和算法,都可以通过 PIG AI 提供的扩展机制来实现。

- 二次开发支持: PIG AI 提供了灵活的二次开发支持,可以根据具体需求进行定制化开发。开发人员可以基于 PIG AI 提供的模型和工具,快速构建出符合业务需求的系统,并且可以根据实际情况进行调整和优化。

- 与 Java 的紧密集成: PIG AI 提供了与 Java 紧密集成的功能,这使得 Java 开发者可以更轻松地使用 PIG AI 的功能。通过 PIG AI 提供的 Java SDK 和 API,开发人员可以在 Java 项目中直接调用 PIG AI 的功能,实现各种智能化应用场景。

综上所述,基于 PIG AI 进行系统开发可以让大模型距离 Java 开发者更近一步,为他们提供了丰富的模型支持、方便的扩展性和二次开发支持。这将有助于开发人员快速构建出功能强大、智能化的系统应用。

# ① 服务端技术栈

- 编程语言:Java17/21

- 开发框架:Spring Boot 3.4 + Spring Cloud 2024

- 安全框架:Spring Security + Spring Authorization Server

- 任务调度:Quartz 、 XXL-JOB

- 流程编排:LiteFlow

- 持久层框架:MyBatis && MyBatis Plus

- 数据库支持: MySQL、Oracle、SQL Server、PostgreSQL、 达梦、 TiDB

# ② 前端技术栈

- 框架:Vue 3.4、TypeScript

- CSS 框架:Sass、TailwindCSS

- 组件库:ElementPlus

- 打包构建工具:Vite

- 状态管理: Pinia

# 配置要求

# ① 配置说明

# ② 私有模型

- 请注意运行 72b 模型为生产级模型,需要 GPU 80G+ 的显存,无法在普通 CPU 条件推理,模型推理速度(可以理解为提问响应速度)取决于硬件配置。

- 如下图: 两块 (A6000 + 48GB)